摘要:本文介绍了DeepSeek-R1的微调与蒸馏过程,以及如何通过这一流程培养领域专家。首先概述了DeepSeek-R1的特点和优势,然后详细描述了微调与蒸馏的技术细节。通过这一过程,模型能够在特定领域进行更精准的适应和优化,进而为领域专家提供有力的支持。本文还探讨了这一路径探索的意义和价值,旨在推动人工智能在特定领域的深度应用和发展。

本文目录导读:

随着人工智能技术的飞速发展,深度学习模型如DeepSeek-R1在众多领域展现出了强大的能力,本文将探讨如何通过微调(fine-tuning)和蒸馏(distillation)技术,使DeepSeek-R1在特定领域成为专家级别的模型,以期为该领域的实际应用提供有力支持。

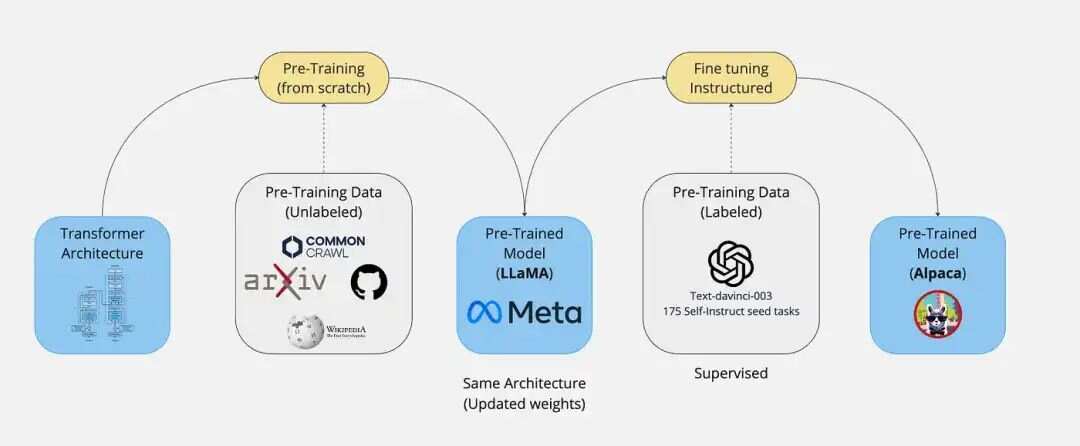

DeepSeek-R1作为一种先进的深度学习模型,已经具备了处理大量数据并产生高质量输出的能力,要让其在特定领域达到专家级别,还需要对其进行领域相关的微调与蒸馏,微调是指对预训练模型进行适应特定任务的参数调整,而蒸馏则是将大型模型的知识转移到小型模型上,以获取更高效的推理性能,本文将详细介绍这两个过程,并探讨如何应用于DeepSeek-R1。

DeepSeek-R1微调

1、数据集准备:收集与特定领域相关的数据集,这些数据集应包括该领域的各种样本,以提供模型学习所需的各种情况。

2、预训练模型:使用大规模数据集对DeepSeek-R1进行预训练,让其学习通用知识,预训练后的模型将具备基本的特征提取和模式识别能力。

3、任务特定调整:根据特定领域的任务需求,对DeepSeek-R1进行微调,这包括修改模型的最后一层以适应新的类别数量,以及调整模型的超参数以优化性能。

4、训练过程:在特定领域的数据集上训练DeepSeek-R1,通过多次迭代,模型将逐渐适应该领域的数据分布和任务需求。

DeepSeek-R1蒸馏

1、教师模型的构建:使用DeepSeek-R1或其他大型模型作为教师模型,教师模型具备丰富的知识和经验,可以指导小型模型的学习。

2、知识蒸馏过程:将教师模型的知识转移到小型模型上,这可以通过最小化学生模型(可能是简化版的DeepSeek-R1)与教师模型的输出差异来实现,在这个过程中,教师模型的知识被“蒸馏”到学生模型中。

3、学生模型的训练:通过蒸馏过程,学生模型将逐渐学习到教师模型的知识,训练过程中,学生模型的性能会逐渐提高,直至达到或接近教师模型的性能。

4、模型优化:对学生模型进行优化,以提高其在特定领域的性能,这可能包括模型压缩、剪枝等技术,以提高模型的推理速度和效率。

实施步骤与策略

1、确定领域需求:明确DeepSeek-R1所要应用的领域,并了解该领域的任务需求和特点。

2、数据收集与处理:收集领域相关数据,并进行预处理以适应模型的输入需求。

3、模型微调:根据领域需求对DeepSeek-R1进行微调,以适应特定任务。

4、知识蒸馏:使用大型模型作为教师模型,将知识蒸馏到DeepSeek-R1或其他小型模型中。

5、模型评估与优化:对微调或蒸馏后的模型进行评估,并根据性能进行进一步优化。

挑战与展望

在实施过程中,可能会面临数据获取困难、计算资源有限等挑战,为了应对这些挑战,可以考虑采用半监督学习、迁移学习等技术,以及利用云计算等资源进行分布式训练,展望未来,随着技术的不断进步,DeepSeek-R1等模型在特定领域的性能将得到进一步提升,为实际应用带来更多可能性。

通过微调与蒸馏技术,DeepSeek-R1可以在特定领域成为专家级别的模型,本文详细阐述了微调与蒸馏的过程和实施步骤,为实际应用提供了指导,随着技术的不断发展,我们期待DeepSeek-R1等模型在更多领域发挥重要作用。

京ICP备11000001号

京ICP备11000001号